SNSで話題のアプリを使ってアイキャッチに

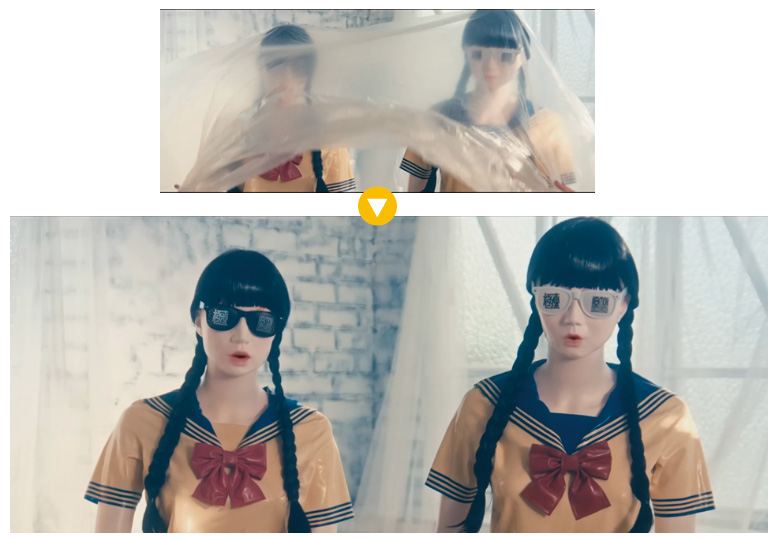

顔を動かすアプリで人形にリップシンクさせたFEMM『CHERRY on TOP』MV

意思を持つ2体のマネキン、RiRiとLuLaによるフィメールラップデュオ・FEMMのラストシングルのMV。2023年11月15日のリリースと同時にMVも公開され、FEMMが歴代のアイコニックな衣装を着用したほか、代表曲『Fxxk Boyz Get Money』を思い出させる振り付けなど、活動10年間のヒストリーが網羅されているような内容になった。

モナリザや織田信長の顔が動く! と話題になったアプリ「Avatarify」

販売元: Avatarify, Inc.

サイズ: 198.9MB

互換性: iPhone iOS 15.0以降、Android 6.0以上

価格: 無料(App内課金あり)

● アプリDL https://avatarify.ai/

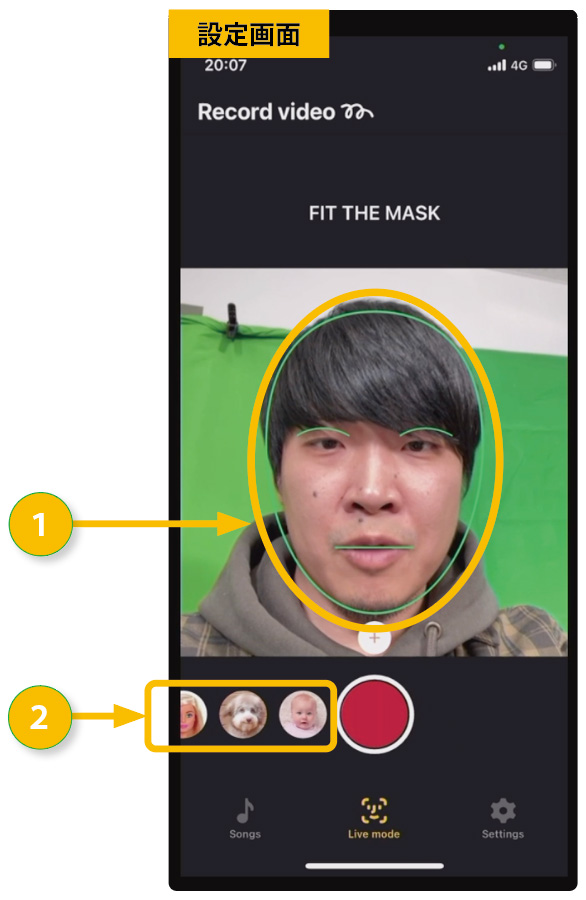

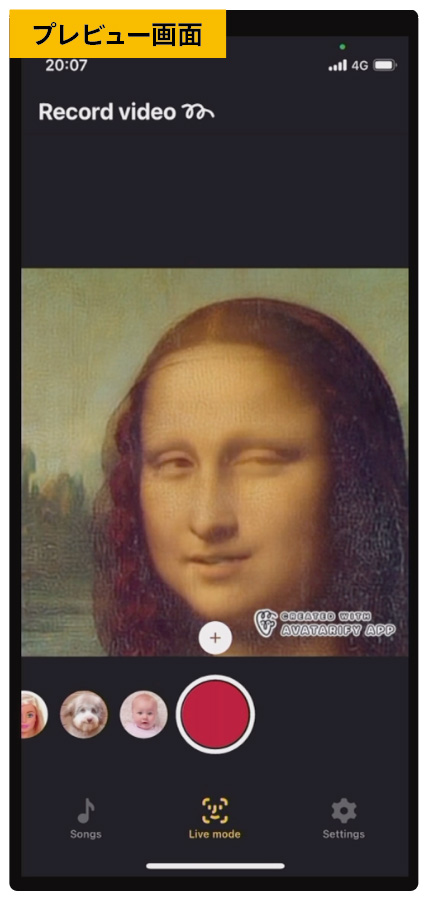

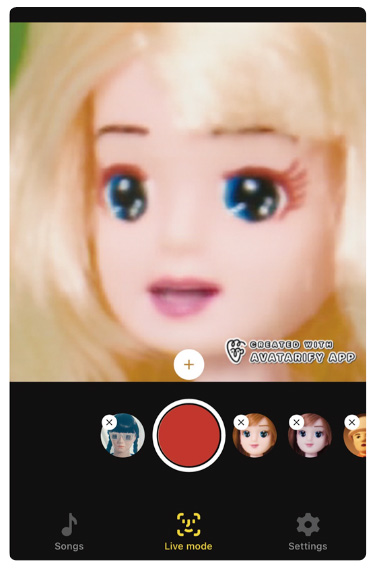

インカメラの映像上に適切な顔の位置を知らせるガイドが表示される。認証された瞬間、自動的にLIVE画像でプレビューできるように。

取り込んだ“顔を動かしたい静止画”がアイコン的に表示される場所。選択するとガイド画面に切り替わる。

人形やマネキンが魂を持つという演出

次はカメラアプリですらないんですけど、「Avatarify」というアプリを使ったFEMM『CHERRY on TOP』のMVの事例です。「Avatarify」は取り込んだ写真の顔を動かすことができる、いわゆるディープフェイクの映像が作れるものになります。

MVの解説をすると、FEMMというアーティストも自分が制作を始めた頃から関わらせてもらっていて、昨年末に活動を休止したので最後のMVのような形になりました。FEMMは「意思を持つ2体のマネキン」というコンセプトのあるアーティストだったので、これまでのMVにもマネキンが出てきたり、人形が出てきたりしていたんです。なので、今回のMVで人形が魂を持つという演出を取り込みたいと考えていました。そんなときに「Avatarify」をちょっと使ってみたらハマるかも…というのが経緯です。

「Avatarify」は読み込んだ画像を自分の口の動きに連動させてリアルタイムに動かせるので、あり得ないキャラクターや人物でリップシンクを撮ったり、動かすことができます。モナリザの顔が動いてしゃべったり歌ったりしている動画を見たことがあるかもしれませんが、SNSでバズったアプリで、映像制作向けのものではありません。

「Avatarify」を使ったのはふたつのシーンで、映像的には本当に一瞬です。それ以外のシーンはREDで撮りましたし、『Y2K』とは違ってカメラマンや照明など、スタッフもいっぱいいました。だからしっかりした映像の中でアイキャッチ的に、エッセンスとしてMVの一部に取り込んだというバランスですね。使い方としてはシネマカメラで撮った映像を静止画としてこのアプリに取り込んで、口の部分だけを使って人形やマネキンにリップシンクしてもらった、ということです。人形やマネキンはもちろん動きませんので、口の部分だけ人のリップとシンクロするように動かしました。

活動休止前の最後のMVということで、FEMMの過去のMVや楽曲を彷彿とさせるような展開になっているんですが、ただ懐かしい映像やシチュエーションを並べるだけでは足りないと思ったんです。この人形やマネキンの口が動いて、歌っているように見せる演出を加えることによって、もうひとつの意味が生まれて企画のフックにできるんじゃないか、と。「Avatarify」自体はファニーなアプリですけど、今回の企画にはすごくマッチしていました。

今後このアプリを映像に使うことがあるかどうかは分かりません。ただ、それもiPhoneアプリのいいところで、「Avatarify」はアプリ内課金をしても数百円で使えますし、別に使わなかったとして数百円でエフェクトを買ったと思えば安いほうです。一度も使わなかったとしても、ひとつの企画の可能性を試す金額としてはお得かもしれません。

「Avatarify」のLive modeというのがメインの機能なんですが、録画ボタンの横に顔を動かせる画像の一覧が表示されます。今回の場合は人形とマネキンですが、その静止画を取り込むと、一覧の中にアイコン的に加わる、と。同じ画面にインカメラの映像が表示されていますが、輪郭と目と顔の適正な位置のガイドがあります。そこに自分の顔を合わせると、自動的にリアルタイム生成されたプレビュー画面に切り替わって、すぐに録画が開始できます…すごくお手軽ですよね。プレビュー・録画の画面はクロップされて正方形で表示されていますが、アプリから書き出すとちゃんと16:9などで映像出力されます。課金しないと強制的にアプリロゴが焼き込まれたり、いろいろ制限があるので、作品に使用するときは数百円の課金が必須ですね。

「Avatarify」から出力された映像をそのまま使ったわけではありません。今回、使いたかったのは口まわりの動きだけですが、出力された映像では口以外の部分もヘンにグニョグニョ動いていて気になったんです。あと、静止画を取り込んでいるので、口以外のカメラワークやズームがなくなってしまうので、そこも調整が必要でした。

世界初かもしれない「Avatarify」をMVの映像に取り込むワークフローを紹介すると、まずREDで撮影した人形やマネキンの映像素材を静止画として書き出します。細かいことを言えば、Logの状態では使えないので、この時点である程度は本番で使いたい色味の状態に持っていく必要がありました。その静止画をアプリに読み込んで、リップシンクの映像を録画します。今回は該当箇所の歌詞を自分でリップして、あたかも人形やマネキンがリップしているみたいな映像を作りました。その映像の書き出して、After Effectsに読み込みます。口部分だけを使いたかったのでマスクで切って、映像素材のレイヤーの上に乗せる、と。先ほどお話しした通り、映像素材はじんわりズームしていたり、動いていたりしたので、口の部分が追従するトラッキングの作業をしました。最後に色味の違いや違和感のある細部をなじませていきます。口のマスクの境界線をボカしたり、色味を整えたり、粒子を足したり…という作業です。

『Y2K』のように撮ったまま使えればベストですが、今回はひと工夫しないと使いづらい素材だったかもしれません。とはいえ、After Effectsで人形にリップシンクさせようとすると、もっと作業は膨大になると思います。口を歪ませたり、動かしたりはできますが、口を開けたときに見える口内はそもそも素材がないので、ゼロから作っていく必要がある…もはやCGの領域になってしまいます。

そう考えると、アプリでサクっとやれたし、Aeの工程も難しいことはしていないので、効果的でした。本来は予算や時間がかかるエフェクトが簡単にできるという点は良かったですし、しかもアイデア的にも作品のテーマと合致していたので、うまくいったかなと思います。

『CHERRY on TOP』MVで「Avatarify」を効果的に使用したふたつのシーン

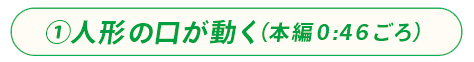

RiRiとLuLaが手に持っていた人形が、命を持って急に歌い出したように見える。

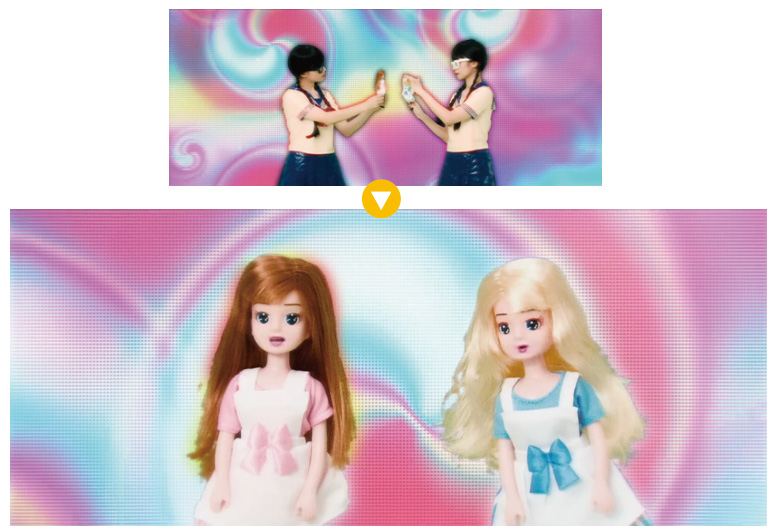

マネキンがリップシンクした後、RiRiとLuLaにビニールを被せられる印象的なラストシーン。

「Avatarify」の映像を撮影素材に組み込むワークフロー

撮影素材からリップシンクさせたいコマの静止画を書き出す

「Avatarify」にその静止画を読み込み、ディープフェイク映像を作成する

「Avatarify」アプリから映像を書き出してAeに取り込む

ディープフェイク映像の口の部分だけをマスクで切り取り、撮影素材に重ねる

撮影素材の動き・ズームに合わせて口の部分をトラッキングする

ディープフェイク映像と撮影素材をなじませる

・マスクの境界線をぼかす

・色味を整える

・粒子を足す

その他のiPhone・iPadの活用方法

クライアントのチェック用モニターとしてiPadが使えるアプリ「HollyView」

販売元: SHENZHEN HOLLYLAND TECHNOLOGY CO.,LTD

サイズ: 22.8MB

互換性: iPhone iOS 13.0以降、iPadOS 13.0以降、Android 6.0以上

価格: 無料

● アプリDL https://apps.apple.com/jp/app/hollyview/id1460631425

Hollyland Mars M1などの映像をiPadやiPhoneなどで受信できるアプリ。少人数やワンオペの現場でも、手軽にカメラの映像を複数のデバイスに飛ばすことができる。写真は左下のカメラに接続されたHollyland Mars M1から、右の三脚に固定されたiPadにワイヤレス送信している様子。クライアント用のモニターとしてだけでなく、カメラから離れた場所にある照明・美術など画を見ながら調整するのにも使える。

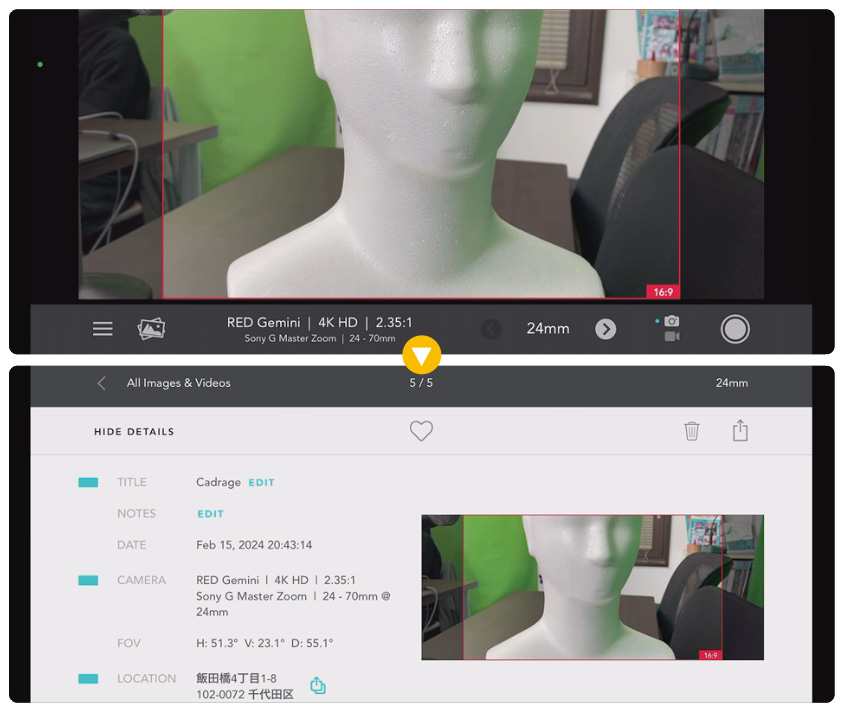

ロケハン時に活躍するカメラ・レンズシミュレーションアプリ「Cadrage」

販売元: Cadrage GmbH

サイズ: 41.1MB

互換性: iPhone iOS 13.0以降、iPadOS 13.0以降

価格: ¥3,000

● アプリDL https://apps.apple.com/jp/app/cadrage-directors-viewfinder/id793232740

さまざまなシネマカメラや一眼カメラのセンサーサイズ、組み合わせるレンズなどシミュレーションして 実際のカメラでの見え方に近い画をiPhoneやiPadで確認できるアプリ。右画像のようにディテールが記録されてチーム内で共有しやすいため、ディレクターやカメラマンがロケハンなどで使用することが多いそうだ。

アイデアしだいで映像全体の質が上がる

完成した映像からは見えない部分でもiPhoneやiPadを活用しています。たとえばクライアントのチェック用モニターとしてiPadを使うことができるアプリ「HollyView」や、AputureのLEDバーライトを遠隔でオペレートできるアプリ「Sidus Link」など、挙げるとキリがありません。他にもディレクターやカメラマンがロケハンに「Cadrage」を使っていたり、照明部が太陽の位置をシミュレーションしてくれるアプリを使っていたり、美術部や制作部が空間スキャン系のアプリで撮影の準備をしていたり…各部署ごとに使っているアプリはいろいろと違うと思います。

これまでめちゃくちゃ大変だったこと、そもそもできるはずもなかったことがiPhoneやiPadのアプリで手軽にできるようになりました。自分が最初にiPhoneを買ったのはiPhone 3の時代で、とりあえずメールと電話はできるけど、他には何ができるの? という感じでしたが、いまはiPhoneだけで何役もできちゃうというところまで進化しています。だから可能性はたくさんあって、撮影だけじゃない、いろんな使い方が今後も出てくるんだと思います。

少人数やワンオペのときにこそiPhoneやiPadの力が発揮されると思っていて、この時代でなければ、いまの自分がやっているような動きはできなかったんだろうと感じます。昔だったらできないようなことが自分ひとりでもできちゃうし、iPhoneやiPadを使うことによって障壁が少なくなっていることはすごいいいことだと思います。

自分の場合、iPhoneでとにかくきれいな映像を撮るというシチュエーションがあまりないので、今後もメインカメラで使うということはないかもしれません。ただ、今回紹介したようにアプリで面白いことができなかなということはいつも考えています。基本的にはiPhoneやアプリが先行するのではなく、企画を考えていくなかでマッチするものを探した結果、iPhoneやアプリに行き着く…ハマるような企画があれば、できるだけトライしてみたいです。

これまでiPhone・iPadの使い方について解説する機会もあまりなかったので、これをきっかけにいろんな可能性があることを知ってもらえるとうれしいですし、アイデアしだいで映像全体の質をグっと上げるポイントになったりすると思うので、みなさんが自分のスタイルに合うような使い方を見つけてほしいと思います。

iPhoneやiPadが必要になるシチュエーション

iPhoneとの連携が想定されたGoPro、OSMO Action、OSMO Pocketなどの機材で外部モニターとして使用している。波多野さんは買い替える前に使っていた先代のiPhoneを撮影専用デバイスとして利用しているそう。

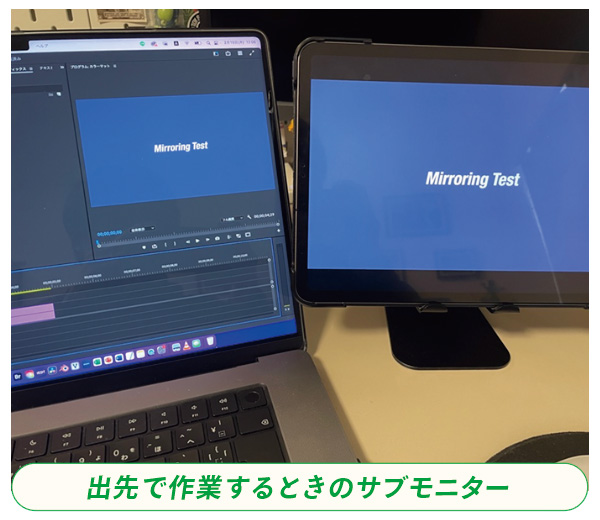

普段の作業環境とは違った場所での作業時(出先で打ち合わせをしながらその場で編集など)に、Sidecarの機能でiPadをサブディスプレイ化。Premiere ProやAfter Effectsでの作業のサブモニター、クライアント用のチェックモニターとして使える。

自分はいまだに3年前ぐらいに買ったものが現役です。以前はiPhoneの新機種が出るたびに買い替えていましたが、いまはあまり意識していないです。今回紹介したような使い方に限れば、まったく問題なく使えているので、最新のiPhoneでないとできない幅が増えてきたら買い替えるかもしれません。

ロケハンに「Cadrage」が使えるとか、照明部は日の出・日の入りが確認できる「Sun Seeker」をよく使っているとか、現場にいると情報が入ってきます。あと、SNSを見ていると新しいアプリを使ったクリップが流れてきて、だいたいは面白系だったりバズネタだったりしますが、頭の片隅に置いておくように意識はしています。